[心得] 終端AI的時代來臨了

看板Stock (股票)作者neo5277 (I am an agent of chaos)時間1小時前 (2026/04/07 00:37)推噓17(19推 2噓 31→)留言52則, 30人參與討論串1/1

有影片好讀版

https://reurl.cc/7EkLDD

GOOGLE 真的做了一件很可怕的事情。

可怕的地方,不是它又發了一個更大的模型,也不是再蓋一座更大的資料中心,而是它正

在把生成式 AI 的主戰場,從雲端慢慢搬到終端。Google AI Edge Gallery 已經公開把

「離線、在裝置上、直接跑開源模型」這件事做成可下載、可體驗、可驗證的產品展示;

Google AI Edge 的 LLM Inference API 也明確把「完全在裝置上執行 LLM」列為正式能

力,Gemma 4 與 Gemma 3n 則持續朝手機、平板、筆電這類 everyday devices 最佳化。

這代表方向已經不是概念驗證,而是平台層、模型層、工具鏈三條線一起往前推。

我自己的判斷,是這個趨勢已經過了「會不會發生」的階段,進入「什麼時候大規模落地

」的階段。我使用 2015 年的 Lenovo Y700、16GB RAM、GTX 960 4GB,實測 Gemma 4

E2B / E4B 在量化後仍有不差的推論速度;另一邊,用 Samsung S24 Ultra 測試(有NPU

,12g記憶體) Google AI Edge Gallery,體感速度如影片我沒有使用影片加速。

這兩個測試的共同訊號很清楚:只要模型夠小、量化夠深、執行框架夠貼近硬體,很多過

去

賴雲端 GPU 的任務,現在已經能在消費級終端本地完成。S24 Ultra 這類手機本身也已

經把 NPU 作為賣點之一,Google 端則直接提供 on-device generative AI 的展示與

API,這不是單點突破,而是供應鏈上下游開始對齊。

模型蒸餾技術相當成熟,剪接嫁支能力,基本不是難事,這也是模型雖然小,卻一定程度

上可以五臟俱全,不是五技而窮的結果。

以現代科技的迭代速度,我會說三年內終端隨身 AI 助理幾乎是必然,因為經濟誘因已

經足夠強。七巨頭過去兩年把 AI 的資本支出拉到前所未有的水位:Meta 2025 年全年資

本支出達 722.2 億美元;Microsoft 在 2025 會計年度第四季單季資本支出就達 242 億

美元;Alphabet 已預告 2026 年資本支出將落在 1750 億到 1850 億美元;Amazon 也已

公開表示 2025 年資本支出提高到 1000 億美元,且絕大部分投入 AI 資料中心。

這些數字說明,雲端推理需求確實還在暴增;但也正因為暴增,雲端才更需要把一部分工

作卸載到用戶手上的裝置。只要能把摘要、意圖辨識、OCR、翻譯、個人知識整理、UI 操

作代理這類高頻任務切到本地端,雲端就能把昂貴算力留給更長上下文、更大模型、

更複雜的多代理工作。

從資金回收角度看,終端 AI 不是雲端的對手,而是雲端資本支出的緩衝器。

這也是 Google 這一步真正厲害的地方。它不是只做模型,而是同時做模型、裝置端推論

框架、展示應用與開發入口。

對使用者來說,AI Edge Gallery 把「本地模型其實已經能用」這件事直接變成體感;

對開發者來說,LLM Inference API 與 LiteRT-LM 把部署門

檻往下壓。當工具鏈成形,真正的競爭就不再只是誰的基礎模型分數高,而是誰能更快把

能力下放到手機、平板、筆電、車機、眼鏡、工控設備與家用裝置。

如果有認識台灣谷歌的人可以內推我嗎? XD 我可以去打雜

再看技術面,量化技術正在把這件事推到更現實的階段。前面提到的本地測試之所以成立

,核心就在量化。低 bit 權重早已不是新題目,但現在更值得注意的是 KV cache 壓縮

。Google Research 今年公開的 TurboQuant,主打在幾乎不損失精度的前提下,大幅壓

縮模型大小與 KV cache;官方直接把它定位為支援 KV cache compression 與向量搜尋

的高效率壓縮方法。

若這類方法進一步成熟並被主流推論框架吸收,終端裝置的瓶頸就不再只是權重能不能塞

進去,而是長上下文能不能維持、記憶體能不能撐住、延遲能不能壓

低。這會直接改寫本地 AI 的可用範圍。過去手機本地 AI 常常只能做短任務,接下來則

可能走向真正的常駐式助理。

想像一下,你有像銀河飛龍 star trek 畢凱艦長胸前的裝置(這樣會不會有點暴露年紀?

或是 HALO CORTANA 真正能透過裝置上感測器,然後本地運行的AI模型,只有特殊高算力

場景才要連上大腦。那可以幫你處理多少事情?

股點來了

從硬體演進來看,未來三到五年最值得注意的不是單純「GPU 更大」,而是記憶體階層會

被重新設計。手機 SoC、NPU、記憶體、封裝內高頻寬記憶體、PC 端更高容量 LPDDR /

CAMM2、邊緣裝置上的低功耗加速器,會逐漸圍繞同一件事最佳化:如何讓 2B、4B、8B

級別模型在可接受的功耗內常駐,並且支援多模態輸入。

Gemma 3n 已經明確強調per-layer parameter caching 與 MatFormer 這類降低計算與

記憶體需求的設計,代表模型架構本身也開始為終端設備重寫。未來不是只有硬體堆料

,而是模型、量化、runtime、記憶體控制器、OS 調度一起往「本地可常駐」靠攏。

技術正在濃縮,精煉,可以說是進入真正軟硬整合的蒸餾狀態。

因此,邊緣 AI 不只會落在旗艦手機。樹莓派、FPGA、低功耗工控板,甚至各種專用

MCU + NPU 模組,都有機會承接某一層 AI 任務。這裡要分清楚:它們未必適合跑完整的

通用聊天模型,但非常適合承接「前處理、本地偵測、事件判斷、語音喚醒、OCR、簡單

代理、短上下文推理」等工作。Google AI Edge 目前已把生成式 AI、視覺、文字、音訊

都納入同一套邊緣開發敘事;而裝置端增量訓練也已經出現在官方文件中。

這代表邊緣設備未來不只是推理端,還可能具備有限度的個人化能力,也意味著統用標準

格式傳遞的出現,早期的xml,網路時代的json,或是二進位的msgpack,甚至更新的規格都

會快速出現。

如果把資金回收與實際應用放在一起看,未來最合理的投資方向,不是再追一輪只服務資

料中心的單一敘事,而是轉往終端整合。原因很簡單:終端 AI 比雲端 AI 更接近現金流

。手機、PC、車機、工業設備、醫療終端、零售裝置、安防攝影機、穿戴設備,每一個品

類都能把 AI 變成實際賣點,進而帶動晶片、記憶體、模組、作業系統、應用軟體與服務

訂閱。

雲端是必要基礎設施,但終端才是最容易把模型能力轉成大量出貨與長期黏著的地

方。這不是說資料中心不重要,而是下一輪回收率更高的競爭,很可能發生在誰能把 AI

變成「隨身、離線、低延遲、可私有化」的日常能力。這一點,Google 現在其實已經先

走了。

我的推論很直接:三年內,本地端隨身 AI 助理大規模出現,機率極高;五年內,終端裝

置的 AI 能力會像相機 ISP、神經網路引擎、5G modem 一樣,從加分項變成標配。真正

值得看的公司與產品,不會只是在資料中心買到最多 GPU 的那一批,而是能把模型壓縮

、記憶體管理、功耗控制、端雲協同與實際場景整合在一起的那一批。在老筆電和旗艦手

機上看到的體感,不是例外,而是前兆。

從模型,到服務,到裝置GOOGLE 現在這一步跟把安卓放出去是一樣....

以我們開發者來說,終端可以應用的場景太多太多了。

但我還是會覺得會有大修正,因為目前從上到下,可以整合所有的

只有GOOGLE 他只有輸B端應用跟服務,待在業界的都知道,GOOGLE最近很用力再衝這塊

真的是不得不佩服老巴跟他的團隊.....

--

WHY SO SERIOUS???

--

※ 發信站: 批踢踢實業坊(ptt.cc), 來自: 1.162.142.99 (臺灣)

※ 文章網址: https://www.ptt.cc/bbs/Stock/M.1775493425.A.D22.html

→

04/07 00:38,

1小時前

, 1F

04/07 00:38, 1F

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 00:39:52

賣掉其他六巨頭,等崩盤後全力買GOOGLE

台灣就買可以拿到他代工的跟GG

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 00:40:47

推

04/07 00:41,

1小時前

, 2F

04/07 00:41, 2F

→

04/07 00:42,

1小時前

, 3F

04/07 00:42, 3F

→

04/07 00:42,

1小時前

, 4F

04/07 00:42, 4F

推

04/07 00:44,

1小時前

, 5F

04/07 00:44, 5F

→

04/07 00:44,

1小時前

, 6F

04/07 00:44, 6F

→

04/07 00:45,

1小時前

, 7F

04/07 00:45, 7F

推

04/07 00:46,

1小時前

, 8F

04/07 00:46, 8F

推

04/07 00:47,

1小時前

, 9F

04/07 00:47, 9F

基本上用一個還可以得有NPU的旗艦機可以寫app 來拓展的話

或著pi系列 做核心不難,難的是電機持久度,跟瞬時反應

推

04/07 00:49,

1小時前

, 10F

04/07 00:49, 10F

推

04/07 00:49,

1小時前

, 11F

04/07 00:49, 11F

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 00:50:57

推

04/07 00:52,

1小時前

, 12F

04/07 00:52, 12F

推

04/07 00:53,

1小時前

, 13F

04/07 00:53, 13F

推

04/07 00:53,

1小時前

, 14F

04/07 00:53, 14F

推

04/07 00:54,

1小時前

, 15F

04/07 00:54, 15F

→

04/07 00:55,

1小時前

, 16F

04/07 00:55, 16F

推

04/07 01:00,

1小時前

, 17F

04/07 01:00, 17F

生成圖還要一下下 擴散模型比較麻煩

→

04/07 01:01,

1小時前

, 18F

04/07 01:01, 18F

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 01:02:38

推

04/07 01:06,

1小時前

, 19F

04/07 01:06, 19F

→

04/07 01:06,

1小時前

, 20F

04/07 01:06, 20F

→

04/07 01:07,

1小時前

, 21F

04/07 01:07, 21F

純推論應該還好 終端版本跟OS一樣持續更新釋出就好

推

04/07 01:08,

1小時前

, 22F

04/07 01:08, 22F

→

04/07 01:08,

1小時前

, 23F

04/07 01:08, 23F

→

04/07 01:09,

1小時前

, 24F

04/07 01:09, 24F

(鼓掌

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 01:11:29

→

04/07 01:12,

1小時前

, 25F

04/07 01:12, 25F

→

04/07 01:12,

1小時前

, 26F

04/07 01:12, 26F

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 01:17:01

→

04/07 01:15,

1小時前

, 27F

04/07 01:15, 27F

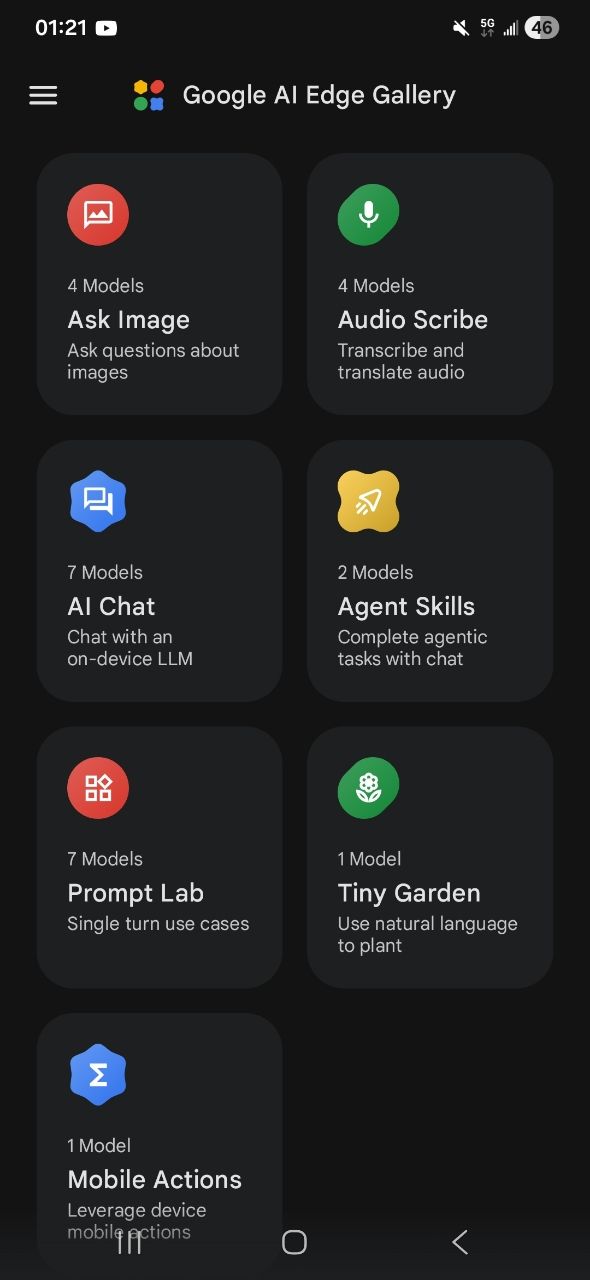

openclaw可以做到的,我都可以開發後在手機上做到一樣的事情,光是Google AI edge

garlley就開放了下面這些給你體驗了

https://i.mopix.cc/1cdBfD.jpg

連控制裝置都有

介接local api就好

※ 編輯: neo5277 (42.71.96.172 臺灣), 04/07/2026 01:21:49

噓

04/07 01:29,

1小時前

, 28F

04/07 01:29, 28F

→

04/07 01:29,

1小時前

, 29F

04/07 01:29, 29F

這跟5090沒有關係啊

光是 s24u 也滿普通的

→

04/07 01:29,

1小時前

, 30F

04/07 01:29, 30F

→

04/07 01:30,

1小時前

, 31F

04/07 01:30, 31F

→

04/07 01:30,

1小時前

, 32F

04/07 01:30, 32F

蒸餾跟微調剪枝以後的slm完全就是本體

....哪裡需要什麼參考資料,這跟RAG不一樣

這是已經訓練好,蒸餾各種功能的模型

,你不會在手機上做微調的,手機上要實作

RAG也不會難,以我這支手機512g的硬碟空間可以放專屬的KM了,終端場景需要什麼龐大

的資料,還是沒有辦法想像,最多做個即時聯網或是連網的資料存取api透過網路加載

跟google地圖一樣而已....

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 01:39:32

推

04/07 01:37,

59分鐘前

, 33F

04/07 01:37, 33F

→

04/07 01:37,

59分鐘前

, 34F

04/07 01:37, 34F

70%的商業應用場景其實不需要模型的多數能力啊,這點終端上本來有的能力結合起來這

個AI核心就好了。

→

04/07 01:37,

59分鐘前

, 35F

04/07 01:37, 35F

因為玩的滿興奮的

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 01:41:56

→

04/07 01:40,

56分鐘前

, 36F

04/07 01:40, 36F

推

04/07 01:48,

48分鐘前

, 37F

04/07 01:48, 37F

→

04/07 01:48,

48分鐘前

, 38F

04/07 01:48, 38F

→

04/07 01:48,

48分鐘前

, 39F

04/07 01:48, 39F

→

04/07 01:48,

48分鐘前

, 40F

04/07 01:48, 40F

→

04/07 01:49,

47分鐘前

, 41F

04/07 01:49, 41F

→

04/07 01:49,

47分鐘前

, 42F

04/07 01:49, 42F

→

04/07 01:49,

47分鐘前

, 43F

04/07 01:49, 43F

推

04/07 01:52,

44分鐘前

, 44F

04/07 01:52, 44F

推

04/07 02:00,

36分鐘前

, 45F

04/07 02:00, 45F

→

04/07 02:01,

35分鐘前

, 46F

04/07 02:01, 46F

噓

04/07 02:03,

33分鐘前

, 47F

04/07 02:03, 47F

推

04/07 02:04,

32分鐘前

, 48F

04/07 02:04, 48F

→

04/07 02:04,

32分鐘前

, 49F

04/07 02:04, 49F

→

04/07 02:04,

32分鐘前

, 50F

04/07 02:04, 50F

前兩代都是蒸餾的啊...

都是從teacher學習部分能力啊..

推

04/07 02:06,

30分鐘前

, 51F

04/07 02:06, 51F

→

04/07 02:06,

30分鐘前

, 52F

04/07 02:06, 52F

※ 編輯: neo5277 (1.162.142.99 臺灣), 04/07/2026 02:08:53

Stock 近期熱門文章

17

52

112

199

88

167

PTT職涯區 即時熱門文章